La nouvelle frontière de l'IA : comment les Big Tech, les startups et SpaceX façonnent la prochaine vague d'intelligence

La nouvelle frontière de l'IA : comment les Big Tech, les startups et SpaceX façonnent la prochaine vague d'intelligence

Contexte et arrière-plan

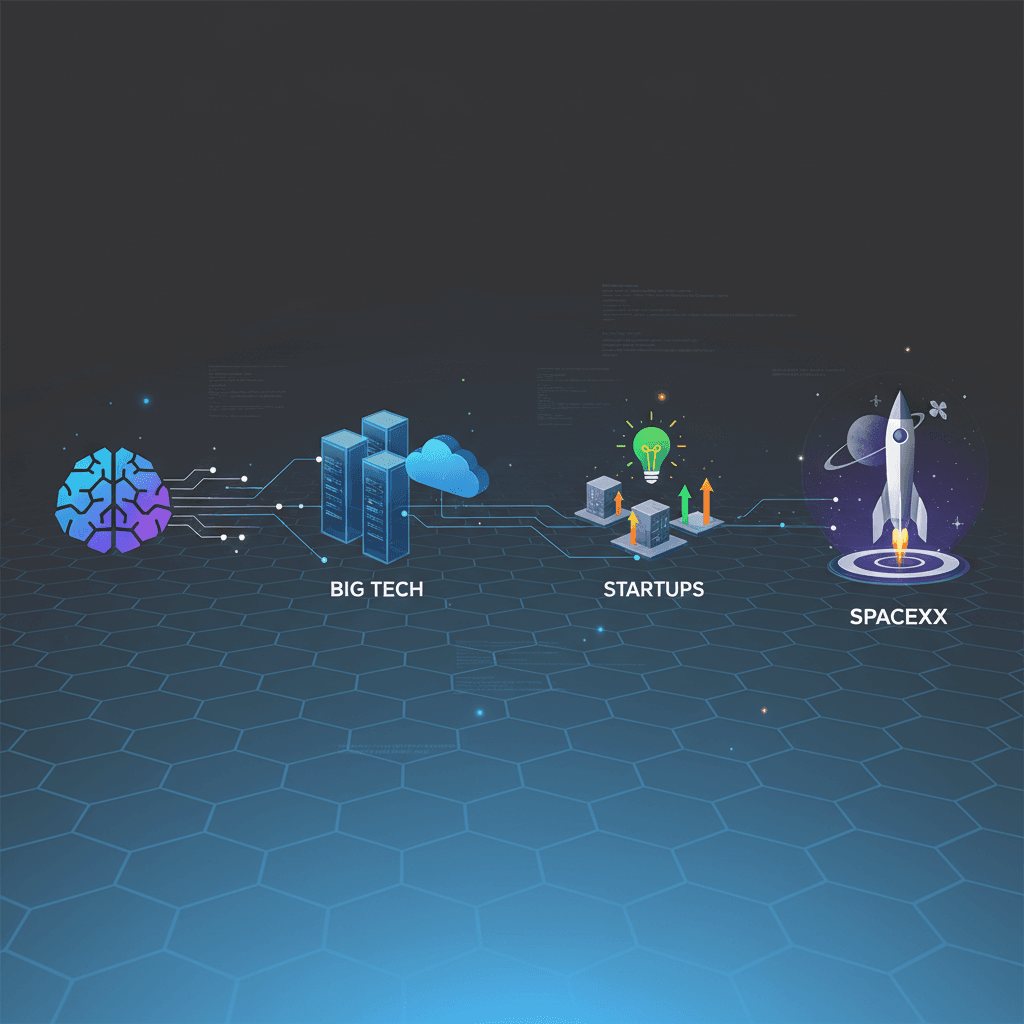

Les trois dernières années ont accéléré un changement tectonique dans l'intelligence artificielle : les modèles fondamentaux sont passés de curiosités de recherche à des plateformes commerciales, les fournisseurs cloud se sont précipités pour proposer des instances spécialisées, et un écosystème foisonnant de startups et d'acteurs établis s'est aligné autour du déploiement, de l'optimisation et de la sécurité des modèles. Alors que les Big Tech continuent de diriger une grande partie du marché grâce à des capacités de calcul massives, l'accès aux données et des services intégrés, une scène de startups dynamique pousse l'innovation à la périphérie — des architectures de modèles efficaces aux nouveaux outils pour développeurs. Parallèlement, SpaceX et des entreprises associées ont introduit un autre axe dans ce paysage : l'intersection de la connectivité, de la collecte de données et des ambitions d'IA verticalement intégrées portées par des acteurs qui couvrent à la fois le logiciel et le matériel.

Calcul, puces et économie d'échelle

La contrainte la plus visible sur le progrès des grands modèles est le calcul. Les hyperscalers et les fournisseurs cloud ont investi massivement dans des fermes de GPU et des accélérateurs sur mesure pour répondre à la demande. Cette concentration crée des avantages naturels pour une poignée d'acteurs capables d'amortir le silicium coûteux et l'infrastructure de refroidissement sur des charges de travail massives. Les startups font face à un calcul difficile : construire des stacks d'inférence propriétaires et risquer une forte intensité de capital, ou concevoir des modèles et des outils optimisés pour fonctionner efficacement sur des instances cloud louées.

Cette dynamique pousse deux tendances parallèles. Premièrement, l'optimisation logicielle — quantification, modèles creux (sparse) et nouveaux compilateurs — réduit le coût de l'inférence et permet de nouveaux cas d'utilisation sur du matériel contraint. Deuxièmement, une résurgence des startups spécialisées en matériel et des recherches sur des accélérateurs spécifiques au domaine vise à élargir qui peut entraîner et servir économiquement de grands modèles. Le résultat est un marché stratifié : les Big Tech contrôlent l'échelle haut de gamme, tandis que les startups et des tiers poussent pour l'efficacité et les déploiements natifs en périphérie.

La posture stratégique des Big Tech : intégration et platformisation

Les grands acteurs poursuivent une stratégie en trois volets : intégrer l'IA dans les produits existants, fournir des plateformes pour développeurs et sécuriser l'approvisionnement à long terme en capacité de calcul. En intégrant des modèles dans la recherche, les suites de productivité et les services cloud, les entreprises convertissent une demande latente en flux de revenus récurrents. Parallèlement, les offres de plateforme — hébergement géré de modèles, services de fine-tuning et connecteurs préconstruits — réduisent les frictions pour les entreprises souhaitant adopter l'IA générative sans la complexité de l'exploitation brute des modèles.

Cette platformisation approfondit le contrôle des acteurs établis sur l'expérience des développeurs et les flux de données, mais elle attire aussi un examen réglementaire et des questions antitrust à mesure que ces entreprises regroupent des capacités d'IA avec des infrastructures cloud et des suites de productivité dominantes.

Startups : spécialisation, composabilité et prise de risque

Les startups restent le creuset de l'innovation. Elles expérimentent des modalités de modèles, des agents spécifiques à un domaine et des outils qui rendent les modèles plus contrôlables et économes en coûts. Beaucoup poursuivent des stacks composables : des composants modulaires qui peuvent être combinés pour créer des produits d'IA sur mesure sans entraîner de nouveaux modèles monolithiques. D'autres se concentrent sur l'ergonomie pour les développeurs — observabilité, plateformes de prompt engineering et MLOps — qui répondent aux douleurs pratiques des entreprises lorsqu'elles passent des pilotes à la production.

Le financement reste robuste mais sélectif : les investisseurs privilégient les équipes capables de démontrer à la fois une nouveauté scientifique et une voie claire vers des coûts opérationnels réduits ou un temps vers le marché plus rapide. Cette logique favorise les méthodes qui extraient plus de performance avec moins de calcul ou qui ouvrent de nouveaux canaux de revenus, comme des applications verticales en santé, finance et automatisation industrielle.

SpaceX : connectivité, données en périphérie et jeu vertical

Bien qu'elle ne soit pas une entreprise d'IA conventionnelle, SpaceX influence l'écosystème IA via deux canaux. Premièrement, sa constellation Starlink change le calcul pour la collecte de données distribuée et le déploiement en périphérie en offrant une connectivité à faible latence plus omniprésente dans des régions auparavant mal desservies. Cette connectivité élargit l'empreinte potentielle des agents d'IA déployés et des flottes IoT, permettant l'inférence en périphérie là où elle était auparavant impraticable.

Deuxièmement, l'essor de ventures IA pilotés par des opérateurs liés aux entreprises spatiales et aérospatiales souligne un appétit pour des produits verticalement intégrés qui combinent matériel, connectivité et logiciels d'IA spécialisés. Les organisations qui contrôlent les dispositifs, les réseaux et les données peuvent optimiser les modèles pour leur télémétrie et leurs contraintes opérationnelles spécifiques — un avantage concurrentiel quand la précision et la latence ont des implications critiques pour la mission.

Implications et perspectives

Les prochaines années seront définies par la tension entre centralisation et décentralisation. Le calcul centralisé et la dominance des plateformes permettent une montée en charge rapide et une adoption par les entreprises, mais les innovations axées sur l'efficacité et la connectivité en périphérie démocratiseront ce qui est possible en dehors du cloud hyperscale. La réglementation influencera de plus en plus les dynamiques concurrentielles, notamment autour de la gouvernance des données, de la sécurité des modèles et de la consolidation du marché.

Pour les startups, la voie à suivre est pragmatique : se spécialiser là où l'échelle n'est pas le principal fossé, optimiser pour le coût et la latence, et construire des composants interopérables qui s'intègrent dans des stacks plus larges. Pour les Big Tech, le défi est de concilier intégration produit, ouverture et confiance des développeurs tiers.

Les acteurs axés sur l'espace et les fournisseurs de connectivité ajoutent une autre dimension : en contrôlant les tuyaux et les points de terminaison, ils peuvent accélérer l'adoption de l'edge AI et créer des chaînes de valeur spécifiques à un domaine qui contournent certaines dépendances traditionnelles au cloud.

En fin de compte, la prochaine phase de croissance de l'IA portera moins sur qui entraîne le plus grand modèle que sur qui peut fournir une intelligence fiable et rentable dans l'ensemble des contextes réels les plus utiles.

Perspectives

Attendez-vous à une spécialisation incrémentale : des modèles plus efficaces, davantage d'outils composables et une co-conception plus approfondie entre matériel et logiciel. Les marchés se bifurqueront en offres intégrées hyperscale et en un écosystème diversifié de fournisseurs de niche optimisés pour le coût, la latence ou des données uniques. Les efforts de politique et de normalisation seront cruciaux pour garantir la concurrence et atténuer les risques systémiques à mesure que l'IA s'intègre davantage dans les infrastructures et les opérations industrielles.

Prêt à protéger votre vie privée ?

Téléchargez Doppler VPN et commencez à naviguer en toute sécurité dès aujourd'hui.